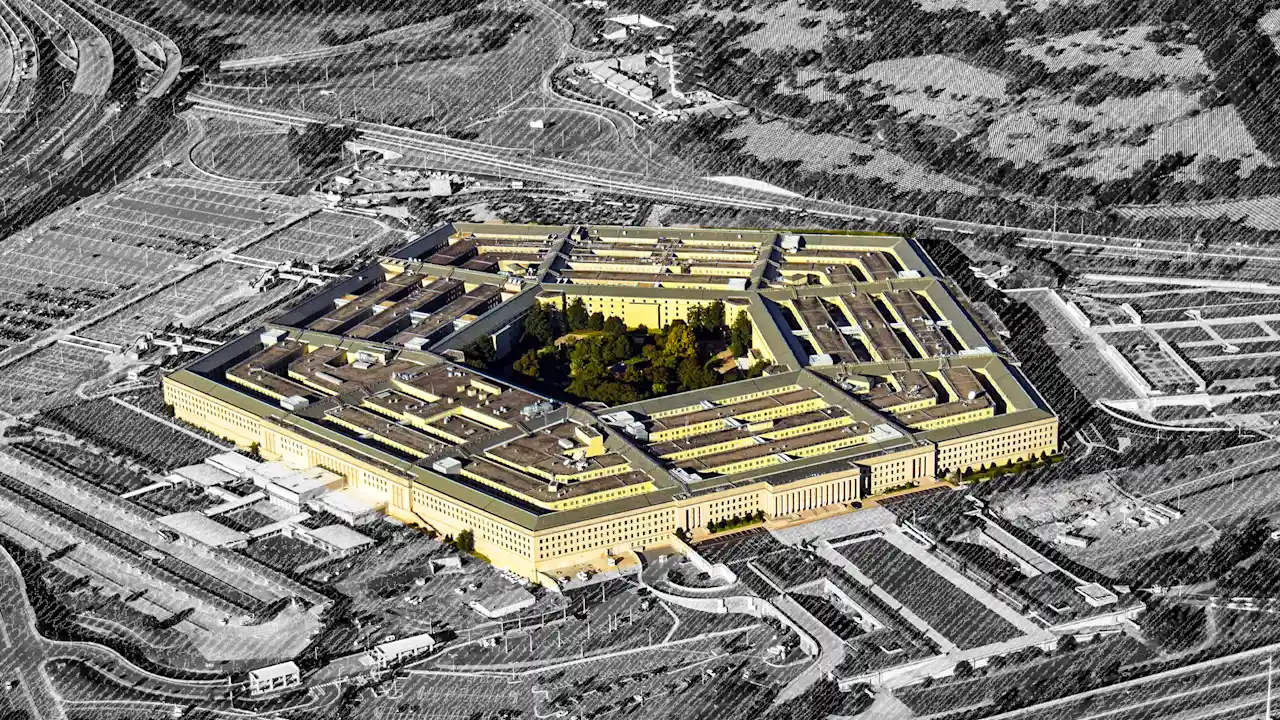

Dario AmodeiDe CEO van Anthropic reist dinsdag naar het Pentagon voor een ontmoeting met de minister van Defensie Piet Hegseth over hoe het leger die van het bedrijf gebruikt kunstmatige intelligentie modellen. En het zal waarschijnlijk een gespannen bijeenkomst worden, zoals de eerste bronnen zeiden Axios.

Contractuele gesprekken tussen de AI-startup en de Ministerie van Defensie zijn de afgelopen weken uit koers geraakt Antropisch heeft aangedrongen op enkele garanties met betrekking tot de manier waarop zijn technologie zal worden gebruikt. Hoewel het in San Francisco gevestigde bedrijf bereid is een aantal gebruiksbeperkingen voor het ministerie van Defensie te versoepelen, wil het niet dat zijn modellen voor ten minste twee specifieke doeleinden worden gebruikt: het bespioneren van Amerikanen of het ontwikkelen van autonome wapens.

Voorafgaand aan de bijeenkomst van dinsdag lijken de twee facties verschillende meningen te hebben over de voortgang van de contractonderhandelingen. Terwijl een woordvoerder van Anthropic maandag in een verklaring zei dat het bedrijf “productief gesprekken, in goed vertrouwen” met het Pentagon, zei een woordvoerder van het ministerie van Defensie vorige week dat de relatie van Anthropic met het Pentagon wordt herzien.

“Anthropic weet dat dit geen kennismakingsbijeenkomst is”, zei een hoge functionaris van het ministerie van Defensie Axios. “Dit is geen vriendschappelijke bijeenkomst.”

DE ROL VAN ANTROPISCH IN NATIONALE VEILIGHEID

Anthropic is momenteel het enige AI-bedrijf dat beschikbaar is in de geheime netwerken van het leger en behoorde tot verschillende bedrijven bekroond met een contract van $ 200 miljoen met het ministerie van Defensie in juli om ‘de nationale veiligheid van de Verenigde Staten te bevorderen’.

Het bedrijf heeft herhaaldelijk zijn engagement herhaald om de nationale veiligheid te ondersteunen, ook op maandag. In juni maakte hij bekend Claudio gouverneureen reeks sjablonen die exclusief zijn gemaakt voor Amerikaanse nationale veiligheidsklanten.

Toch heeft Amodei zich uitgesproken over het balanceren van de kansen die AI biedt en de zorgen die het met zich meebrengt. In de lang stuk Vorige maand gepubliceerd waarschuwde de medeoprichter van Anthropic: “De mensheid staat op het punt een bijna onvoorstelbare macht te verwerven, en het is zeer onduidelijk of onze sociale, politieke en technologische systemen de volwassenheid bezitten om die macht uit te oefenen.”

Op de India AI Impact Summit vorige week zei Amodei dat hij zich zorgen maakte over het autonome gedrag van AI-systemen en het mogelijke misbruik van AI door individuen en overheden.

DE MADURO-FACTOR

Een andere factor die de betrekkingen tussen Anthropic en het Pentagon onder druk heeft gezet, kwam vorige week aan het licht: Claude werd eerder dit jaar gebruikt bij de Amerikaanse militaire operatie om de voormalige Venezolaanse president Nicolás Maduro gevangen te nemen. De Wall Street Journal gemeld. Het lijkt erop dat deze missie in strijd is met de gebruiksrichtlijnen van Anthropic, die onder meer het gebruik van Claude verbieden om aan te zetten tot geweld of voor strafrechtelijke en surveillancedoeleinden.

Die van het bedrijf gebruiksbeleidHet is voor het laatst bijgewerkt in september en is bedoeld om “een optimaal evenwicht te vinden tussen het mogelijk maken van nuttig gebruik en het beperken van potentiële schade.”

Maar Anthropic merkt ook op dat het bedrijf “contracten kan sluiten met bepaalde overheidsklanten die gebruiksbeperkingen afstemmen op de publieke missie en wettelijke autoriteiten van die klant, als, naar het oordeel van Anthropic, de toepasselijke contractuele gebruiksbeperkingen en garanties voldoende zijn om potentiële schade te beperken.”

NEEM DE BEER

Anthropic heeft geprobeerd zich te onderscheiden van de rest van het universum van AI-ontwikkelaars met een ‘veiligheid eerst’-benadering, waardoor het zelfs een grote vlucht heeft genomen. via een Super Bowl-commercialop het recente besluit van OpenAI om advertenties in het ChatGPT-platform in te sluiten.

Hoewel Amodei zich soms als een tegendraads mens heeft ontpopt, door het onbeperkte gebruik van zijn AI-model Claude voor het Amerikaanse leger af te wijzen, steekt hij feitelijk de beer die Hegseth heet aan.

ALS Axios Vorige week meldde Hegseth dat het Pentagon Anthropic zou kunnen bestempelen als een ‘toeleveringsketenrisico’, waardoor zijn contracten ongeldig zouden worden verklaard en andere bedrijven die met het Pentagon samenwerken zouden worden gedwongen te verklaren dat ze Claude niet gebruiken in gerelateerde werkstromen.

“Onze natie vereist dat onze partners bereid zijn onze oorlogsstrijders te helpen winnen in welke strijd dan ook”, zei hoofdwoordvoerder van het Pentagon, Sean Parnell, vorige week tegen de media. “Uiteindelijk gaat dit over onze troepen en de veiligheid van het Amerikaanse volk.”