Welkom bij NAAR DE gedecodeerd, Snel bedrijfDe wekelijkse nieuwsbrief die het belangrijkste nieuws uit de wereld van kunstmatige intelligentie analyseert. Ik ben Mark Sullivan, een senior schrijver bij Snel bedrijf, over opkomende technologie, kunstmatige intelligentie en technologiebeleid.

Deze week zal ik me concentreren op het grootste verkoopvoorstel van AI, AGI-onderzoek, en het idee dat de industrie zich moet concentreren op meer bescheiden, haalbare taken voor AI. Ik kijk ook naar de nieuwe financiering van Databricks van meer dan $4 miljard en het nieuwe Gemini 3 Flash-model van Google.

Schrijf u in om deze nieuwsbrief wekelijks per e-mail te ontvangen Hier. En als u opmerkingen heeft over dit onderwerp en/of ideeën voor toekomstige kwesties, stuur mij dan een e-mail op sullivan@fastcompany.com en volg mij op X (voorheen Twitter) @thesullivan.

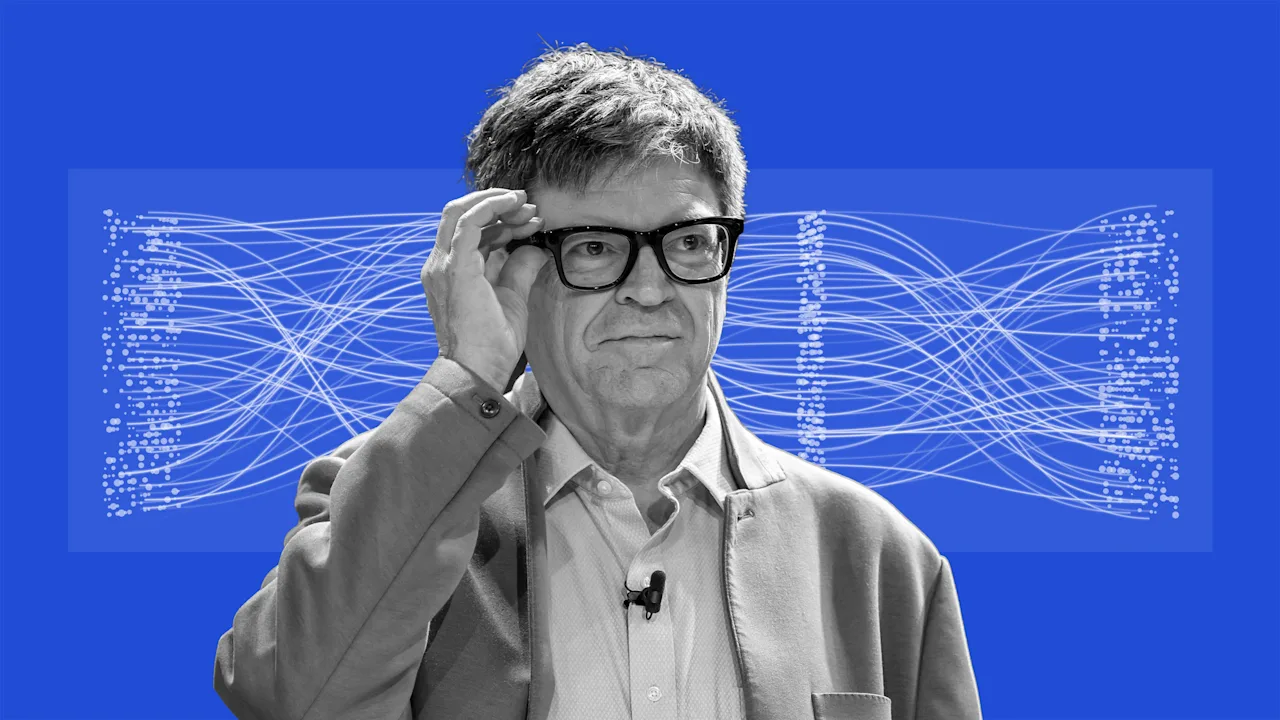

Yann LeCun noemt “kunstmatige algemene intelligentie” onzin

Grote AI-bedrijven als OpenAI en Anthropic praten graag over hun gedurfde streven naar AGI, of kunstmatige algemene intelligentie. De definitie van Graal is enigszins flexibel gebleken, maar verwijst in het algemeen naar kunstmatige-intelligentiesystemen die net zo intelligent zijn als mensen in een breed scala aan taken. AI-bedrijven hebben dit ‘onderzoeksverhaal’ gebruikt om investeringen binnen te halen, de technische pers te boeien en politici te boeien.

Nu zet een van de meest prominente pioniers van kunstmatige intelligentie, Turing Award-winnaar Yann LeCun, het hele concept in twijfel. LeCun, de vertrekkende hoofd-AI-wetenschapper van Meta, stelt dat mensen ook niet echt generalisten zijn. Ze zijn goed in sommige fysieke taken en erg goed in sociale interacties, maar ze kunnen gemakkelijk door een computer worden verslagen bij het schaken en kunnen geen berekeningen uitvoeren met de snelheid en nauwkeurigheid van een rekenmachine. “Er zijn taken waar veel andere dieren beter in zijn dan wij”, zei LeCun in een recent artikel Informatieknelpunt webcast.

“We beschouwen onszelf als generaals, maar dat is simpelweg een illusie, omdat alle problemen die we kunnen begrijpen ook de problemen zijn waar we aan kunnen denken, en omgekeerd,” zei LeCun. “Dus we zijn algemeen in alle problemen die we ons kunnen voorstellen, maar er zijn veel problemen die we ons niet kunnen voorstellen. En daar zijn veel wiskundige argumenten voor. Dus dit concept van algemene intelligentie is totale onzin.”

Veel mensen op het gebied van kunstmatige intelligentie en neurowetenschappen zijn het niet eens met LeCun. Het feit dat mensen niet de beste zijn in alle taken, of in taken die we ons niet kunnen voorstellen, betekent niet dat we geen generalisten zijn, vooral niet in vergelijking met experts op het gebied van machines zoals computers, zo stellen ze. Ik weet niet wie gelijk heeft, maar LeCun heeft een breder punt. Hij is van mening dat AI-laboratoria zich moeten concentreren op specifieke dingen uit de echte wereld die AI kan doen – dingen die waarde creëren of lijden verminderen, misschien – en die oplossingen op de markt moeten brengen.

LeCun zegt dat de huidige grote, op transformatoren gebaseerde taalmodellen nuttig genoeg zijn om op geldige manieren te worden toegepast, maar hij gelooft ook dat het onwaarschijnlijk is dat ze de algemene of menselijke intelligentie zullen bereiken die nodig is om hoogwaardige werktaken uit te voeren die nu zijn voorbehouden aan het menselijk brein. Om net als mensen door de complexiteit van de echte wereld te kunnen navigeren, zou AI een trainingsregime nodig hebben met een veel grotere bandbreedte dan alleen woorden, afbeeldingen en computercode, betoogt LeCun, en een andere architectuur om alle gegevens te structureren. In het bijzonder Il Financiële tijden meldt dat LeCun 585 miljoen dollar ophaalt tegen een waardering van 3 miljard dollar voor een nieuwe AI-startup die zal proberen ‘wereldmodellen’ te bouwen: AI-systemen die in staat zijn om leren van afbeeldingen, video’s en ruimtelijke gegevens, in plaats van alleen maar tekst en grote taalmodellen.

Databricks verdient nog eens $4 miljard, de waardering stijgt naar $134 miljard

Data- en AI-bedrijf Databricks heeft ruim $4 miljard opgehaald in een nieuwe Series L financieringsronde geleid door Insight Partners, Fidelity en JP Morgan Asset Management, met betrokkenheid van Andreessen Horowitz, BlackRock en Blackstone. De waardering van het bedrijf steeg met de nieuwe ronde naar $134 miljard.

De rating weerspiegelt de positionering van Databricks in de bloeiende markt voor AI-clouddiensten. Het kernaanbod van het bedrijf bestaat al jaren uit veilige cloudopslag voor gevoelige bedrijfsgegevens, waaronder gegevens die worden bewaard door bedrijven in gereguleerde sectoren zoals de gezondheidszorg en de financiële sector. De afgelopen vijf jaar heeft Databricks zich dieper verdiept in de ontwikkeling van de AI-kant van zijn bedrijf. Dankzij de waardepropositie kunnen klanten hun gegevens beheren via krachtige AI-modellen die in dezelfde veilige cloud worden gehost. Meer recentelijk heeft het bedrijf een veilig platform gecreëerd voor het ontwikkelen en inzetten van autonome agenten die bijvoorbeeld in staat zijn complexe business intelligence-rapporten samen te stellen op basis van diverse datasets die zijn opgeslagen in de Databricks-cloud.

Het bedrijf biedt klanten ook de mogelijkheid om hun gegevens via modellen van derden, van onder meer OpenAI en Anthropic, te laten draaien door deze modellen native in de beveiligde cloud te hosten. Nu zegt Databricks dat zowel zijn datawarehousing- als kunstmatige-intelligentiebedrijven elk omzetcijfers van meer dan $ 1 miljard hebben. Het bedrijf rapporteerde een omzet van $4,8 miljard in het derde kwartaal van 2025, wat neerkomt op een groei van ongeveer 55% vergeleken met dezelfde periode in 2024.

Bijna precies een jaar geleden haalde Databricks een enorm bedrag op Financieringsronde van $10 miljardeen van de grootste ooit voor een AI-bedrijf, en bereikte een waardering van $62 miljard. (De waardering steeg tot $100 miljard toen het bedrijf in augustus een financieringsronde van $1 miljard ophaalde.)

Het in San Francisco gevestigde bedrijf zegt dat het het nieuwe kapitaal zal gebruiken om nieuwe op AI gebaseerde toepassingen te ontwikkelen, toekomstige overnames te financieren, onderzoek en ontwikkeling te ondersteunen en werknemers te betalen (hoogstwaarschijnlijk inclusief duur AI-onderzoekstalent). Met honderden klanten die elk meer dan $1 miljoen aan jaarlijkse omzet bijdragen en een hoog klantbehoudpercentage, wordt Databricks beschouwd als een sterke IPO-kandidaat. Het bedrijf wacht mogelijk op optimale marktomstandigheden waarin het zich kan aanmelden.

Google brengt een Gemini 3-model uit, “Flash”, voor de rest van ons

Nu kunnen zelfs mensen die zich geen maandelijks abonnement kunnen veroorloven, genieten van de magie van het nieuwe Gemini 3-model van Google DeepMind. Google bracht in november het eerste Gemini 3-model uit, de Pro, maar deze was alleen beschikbaar voor betalende abonnees. Het is nieuw 3Flash-tweelingen de variant is nu de standaard in de Gemini-app en is wereldwijd beschikbaar in de AI-modus van Google Search.

Er wordt gezegd dat Flash drie keer sneller reageert dan de Gemini 2.5 Pro en bijna net zo goed in redeneren als het Gemini 3 Pro-model. Flash is ontworpen om betaalbaar te zijn, waardoor het volgens Google een geweldige optie is voor ontwikkelaars en bedrijven.

Het nieuwe model laat een aantal indrukwekkende resultaten zien op het gebied van redeneren en kennis op doctoraal niveau, zoals GPQA Diamond (90,4%) en Humanity’s Last Exam (33,7% zonder hulpmiddelen). Deze scores liggen dicht bij die van grotere modellen, waaronder Gemini 3 Pro en OpenAI’s GPT-5.2. Flash behaalde ook de hoogste score van alle modellen (81,2%) in de MMMU Pro benchmark, die het vermogen meet om een mix van tekst en visuele gegevens te begrijpen en erover te redeneren.

Bij verwerking op het hoogste denkniveau kan Gemini 3 Flash ‘moduleren’ hoeveel het ‘denkt’, zegt Google. Bij complexere vragen zal het langer duren om de in het geheugen verzamelde gegevens te verwerken om tot een antwoord te komen. Maar hij gebruikt ook (gemiddeld) 30% minder tokens dan de Gemini 2.5 Pro om de eenvoudigste dagelijkse taken uit te voeren. Onderzoekers van Big AI Labs hebben er hard aan gewerkt om AI-modellen de (vaak omvangrijke) contextuele gegevens die ze verzamelen efficiënter in het geheugen te laten opslaan en effectiever te laten gebruiken.

Verhoogde AI-dekking van Snel bedrijf:

- Elke AI-oprichter denkt dat hij een megainvesteringsronde wil. Geloof me, dat doe je niet

- 5 voorspellingen over de groeiende rol van kunstmatige intelligentie in de media in 2026

- De leider van DOGE bij Treasury wil duizenden ChatGPT-licenties kopen

- Wie moet betalen voor het elektriciteitsnet om datacenters bij te houden?

Wilt u exclusieve rapporten en trendanalyses over technologie, bedrijfsinnovatie, de toekomst van werk en design? Registratie Voor Snel bedrijf Onderscheiding.